Крупный технологический гигант Google объявил о прорыве в области оптимизации работы больших языковых моделей (LLM). Компания представила новый алгоритм сжатия TurboQuant, который позволяет сократить потребление памяти, необходимой для хранения контекста генерации текста, в шесть раз. Технология нацелена на решение одной из ключевых проблем современных ИИ-систем — дефицита оперативной памяти, который сдерживает развитие и масштабирование моделей.

TurboQuant работает с механизмом KV cache — системой, хранящей ключи и значения (key-value pairs) для каждого токена, обработанного моделью. Без этой памяти LLM не могли бы поддерживать когерентность диалога или генерировать связные ответы. Однако хранение таких данных требует огромных объемов ОЗУ, что делает обучение и инференс дорогостоящими процессами. Новый алгоритм компании Google радикально снижает эту нагрузку, сохраняя при этом точность модели на прежнем уровне.

Помимо сокращения потребления памяти, TurboQuant обещает ускорить работу LLM в восемь раз. Это означает, что модели смогут обрабатывать запросы быстрее, а пользователи получат более отзывчивые и эффективные инструменты на базе искусственного интеллекта. В компании подчеркивают, что технология совместима с большинством существующих архитектур, что открывает широкие перспективы для её внедрения в различные продукты и сервисы.

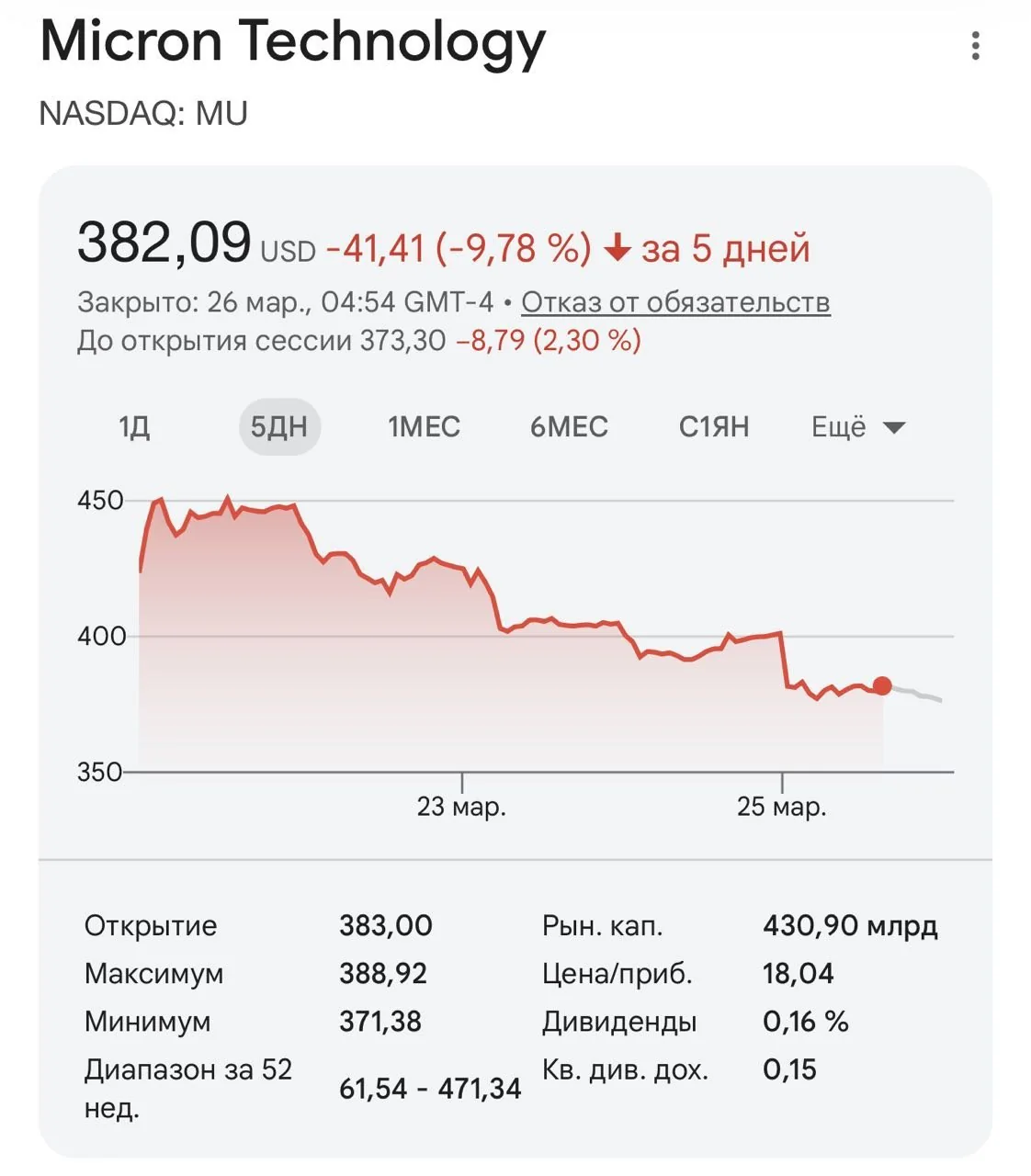

Реакция рынка на анонс была моментальной. Акции ведущих производителей памяти, таких как Micron и SK Hynix, резко упали в цене. Инвесторы, опасаясь снижения спроса на дорогостоящие чипы, начали массово избавляться от активов. Эксперты связывают это с ожиданиями, что новые алгоритмы, подобные TurboQuant, смогут значительно сократить потребность в аппаратных ресурсах для развёртывания ИИ-моделей.

Эксперты отмечают, что такой подход может стать важным шагом на пути к более доступным и массовым решениям на базе искусственного интеллекта. Если технология получит широкое распространение, это откроет новые возможности для разработчиков, стартапов и крупных корпораций, которые смогут внедрять мощные модели без необходимости инвестировать миллиарды в инфраструктуру. В то же время производители аппаратного обеспечения столкнутся с вызовами, требующими адаптации к новым реалиям рынка.