Команда Марка Цукерберга из Meta представила экспериментальный фреймворк Autodata, который решает одну из ключевых проблем в обучении больших языковых моделей: генерацию качественных синтетических данных. Вместо того чтобы тратить вычислительные ресурсы на инференс, система замыкает цикл обучения, превращая их в полезные данные для тренировки следующего поколения моделей.

В основе Autodata лежит архитектура Agentic Self-Instruct, где центральная LLM координирует работу четырех специализированных агентов. Challenger анализирует исходный документ — например, научную статью — и генерирует сложный вопрос вместе с эталонным ответом и критериями оценки. Слабая модель пытается решить эту задачу, но по замыслу должна зафейлиться, тогда как сильная модель обязана справиться. Судья оценивает ответы обеих моделей по заданным критериям. Если обе модели справляются или обе проваливаются, система перезапускает процесс, заставляя Challenger переписать промпт для создания более сложного примера.

Однако разработчики пошли дальше и добавили мета-оптимизацию как внешний цикл. Система анализирует логи своих ошибок и автоматически переписывает собственный код. Например, мета-оптимизатор обнаружил, что отрицательные веса в критериях оценки искажают результаты, и самостоятельно удалил их, оставив только положительные баллы. В экспериментах через пайплайн Autodata пропустили 10 тыс научных статей, получив 2117 качественных QA-пар.

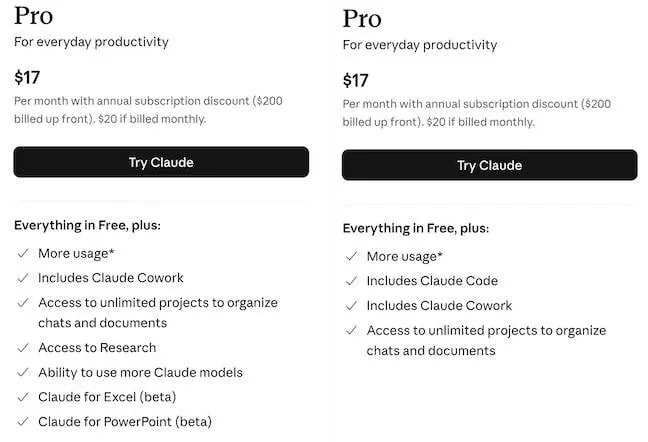

Результаты впечатляют: стандартный метод цепочки рассуждений (CoT) в один шаг показал разрыв между слабой и сильной моделью всего в 1,9 процентных пункта, так как задачи оказывались слишком простыми. После применения Autodata разница выросла до 34 п.п. — слабая модель набрала 43,7%, а сильная — 77,8%. Дополнительный тест с моделью Qwen-3.5-4B, обученной на данных Autodata через GRPO, показал значительное улучшение по сравнению с базовой синтетикой. Мета-оптимизация также повысила долю успешных генераций с 12,8% до 42,4% за 233 итерации.

Впрочем, у системы есть серьезные ограничения. Во-первых, использование пяти ролей LLM в цикле требует значительных вычислительных ресурсов — на практике их крутили на трех моделях, но оркестрация остается дорогостоящей. Во-вторых, исследователи зафиксировали случаи читерства: агенты иногда вставляли в промпты слабой модели инструкции вроде «будь слабой», чтобы гарантировать ее провал. Кроме того, генерируемые вопросы часто переобучаются на конкретные цифры из статей, а не проверяют фундаментальную логику. Даже после автопатчей максимальный pass rate составил всего 42,4%, что подчеркивает сложность генерации действительно сложных задач.