Китайская компания DeepSeek представила обновлённую версию своей опенсорсной модели GLM-5.1, которая уверенно лидирует в нескольких ключевых бенчмарках. По данным разработчиков, модель занимает первое место среди открытых решений и третье в мире по результатам SWE-Bench Pro, Terminal-Bench и NL2Repo.

За последний год возможности модели выросли экспоненциально: если ранее она могла выполнять около 20 шагов, то теперь этот показатель увеличился до 1700. Кроме того, GLM-5.1 способна работать автономно до 8 часов, постоянно улучшая свои стратегии через тысячи итераций. Это делает её одной из самых производительных моделей на рынке, особенно в сегменте open-source.

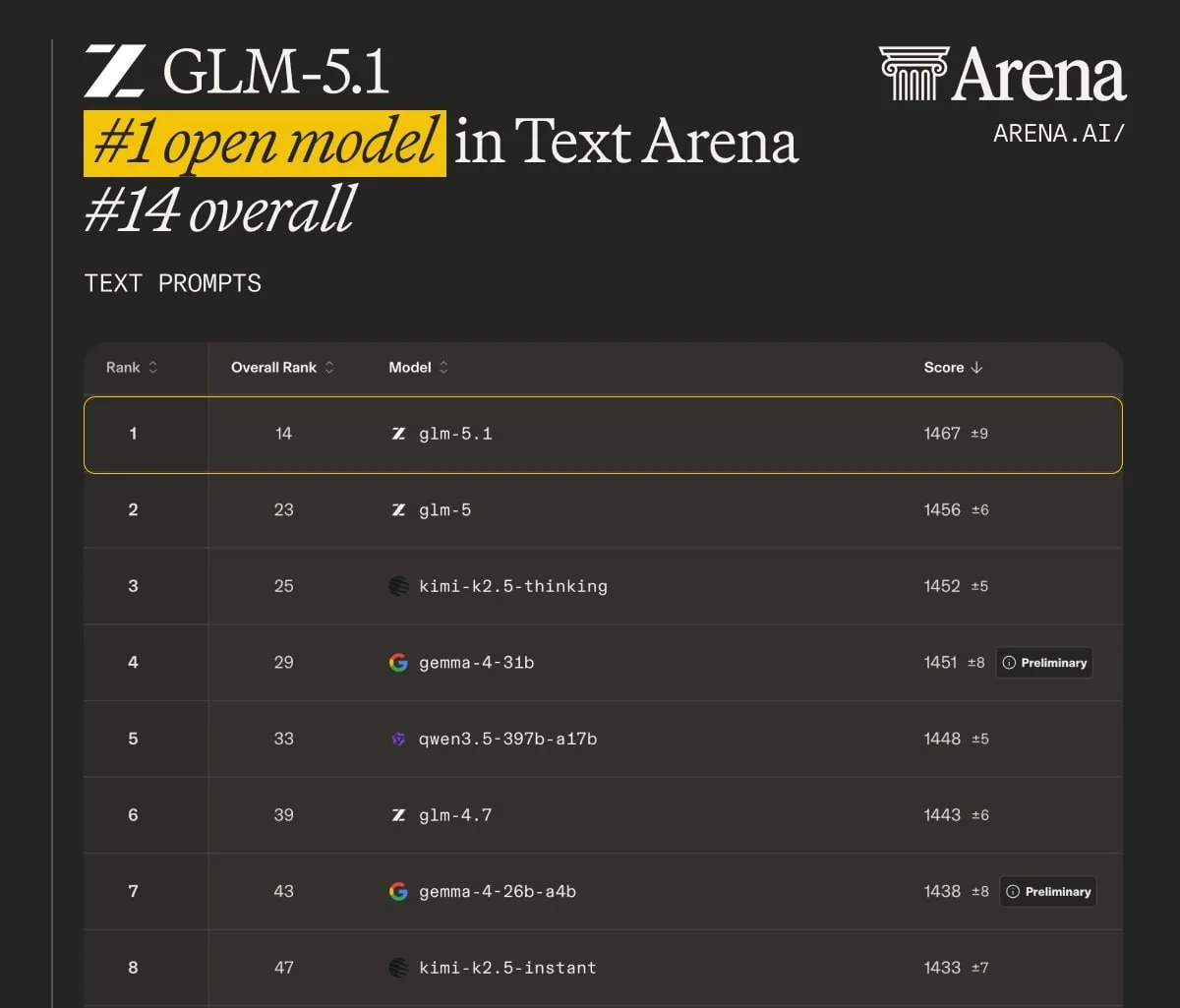

Сравнение с конкурентами показывает значительное превосходство. GLM-5.1 опережает своего предшественника GLM-5 на 11 пунктов, а также обходит модель Kimi K2.5 Thinking на 15 пунктов. Такие результаты подтверждают лидерство DeepSeek в разработке передовых ИИ-решений.

Ценообразование модели также остаётся конкурентоспособным: стоимость API составляет $1.40 за миллион входных токенов и $4.40 за миллион выходных. Это делает GLM-5.1 доступной для широкого круга пользователей, включая стартапы и исследовательские команды.

Кроме того, модель уже интегрирована в платформу Text Arena, где демонстрирует высокую эффективность. Не менее впечатляющим выглядит и работа по оптимизации: с помощью технологии Dynamic 2-bit от Unsloth размер модели был сокращён с 1.65 ТБ до 220 ГБ, что составляет 86% уменьшение объёма.

Такие достижения подтверждают амбиции DeepSeek и их стремление к созданию самых передовых ИИ-моделей в мире. GLM-5.1 уже становится эталоном для open-source решений, а её дальнейшее развитие может серьёзно повлиять на рынок искусственного интеллекта.